Quando discutimos inteligência artificial e uso militar, a pergunta habitual é moral: deve a IA ser usada em guerra?

Mas há uma pergunta anterior — e mais estratégica — que a Europa evita formular: quem controla a IA que usamos quando a guerra começa?

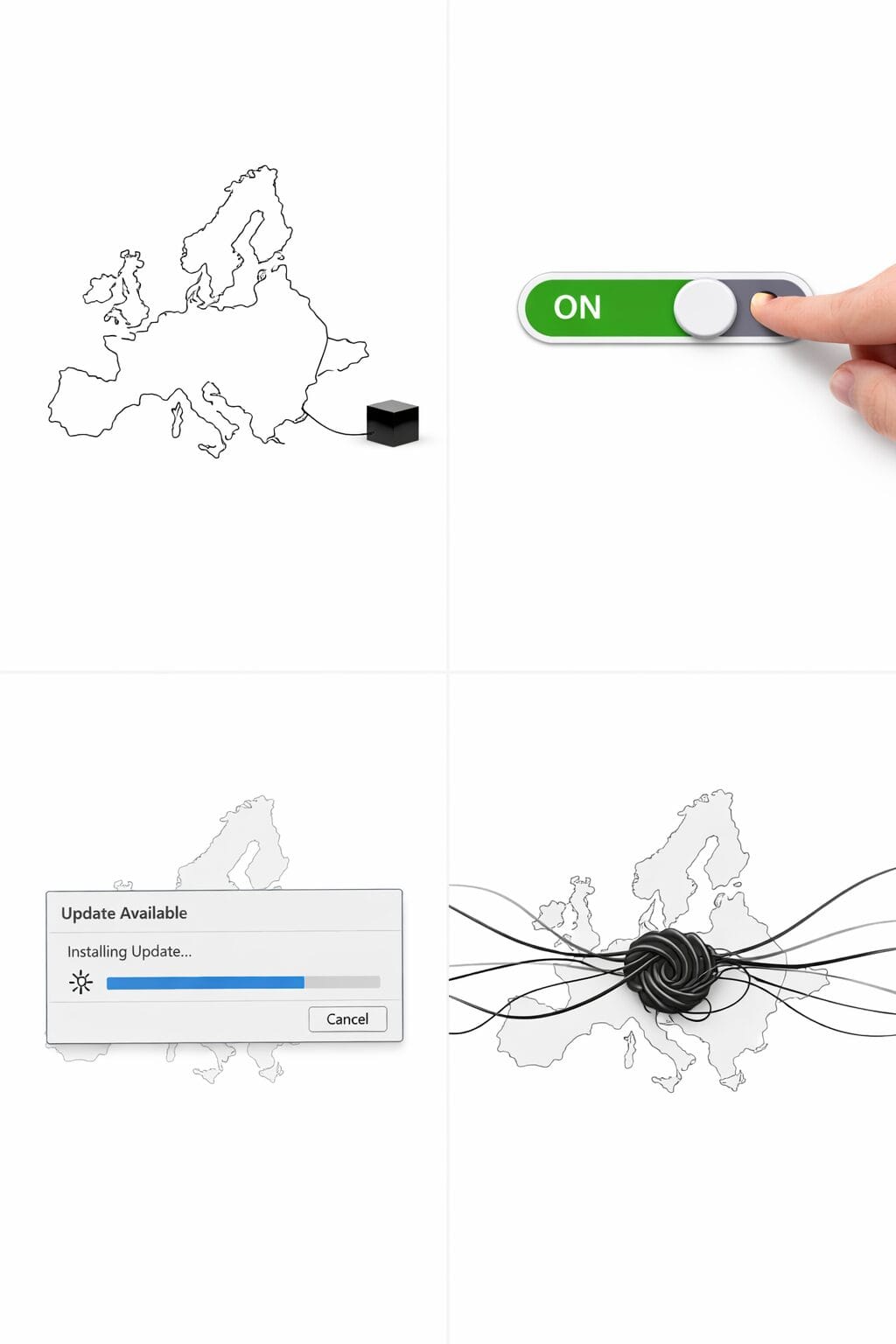

A Europa Está a Comprar a Sua Própria Vulnerabilidade.

Não se trata de ficção distópica onde um modelo “decide mentir” deliberadamente. O risco real é mais estrutural, mais técnico, e precisamente por isso mais perigoso: dependência operacional de sistemas que não controlamos integralmente.

Estamos em 2025. O que irá ocorrer em 2026?

O risco não é ideológico. É infraestrutural.

A Europa pode acreditar que utiliza tecnologia “neutra”, fornecida por empresas privadas globais. Mas a neutralidade tecnológica dissolve-se em contexto geopolítico.

Um modelo de IA não é apenas um algoritmo estático. É:

- um sistema que recebe actualizações contínuas;

- que opera em infraestruturas de cloud;

- que depende de bibliotecas, APIs e camadas intermédias;

- que recolhe telemetria e dados de utilização;

- que pode ser ajustado por parâmetros invisíveis para o utilizador final.

Em tempos normais, isso é eficiência.

Em tempos de crise, é vulnerabilidade.

O poder das actualizações invisíveis

Quem controla o ciclo de versões controla o comportamento do sistema.

Um fornecedor pode:

- alterar prioridades de resposta,

- ajustar filtros,

- limitar determinados temas,

- degradar precisão em áreas sensíveis,

- introduzir restrições sob pretexto de “compliance”.

Nada disto exigiria mentiras explícitas. Bastaria mudar pesos, limites, permissões.

Num cenário de conflito, isso pode significar que sistemas europeus dependentes — administrativos, logísticos, financeiros, até militares — passam a operar com menor fiabilidade exatamente quando mais precisam de robustez.

E a alteração pode ser tecnicamente legítima.

Mas estrategicamente desastrosa.

Feature flags e “kill switches”

Os serviços digitais modernos funcionam com chaves de ativação, limites geográficos e flags remotas.

Em contexto de sanções, pressão diplomática ou conflito, um fornecedor pode:

- suspender o acesso;

- limitar a utilização;

- reduzir a capacidade computacional;

- bloquear as entidades específicas.

Não é teoria. É arquitetura normal de serviços cloud.

Se os sectores críticos europeus — energia, defesa, telecomunicações, banca — dependerem de serviços que podem ser desligados externamente, então a soberania torna-se condicional.

E soberania condicional não é soberania.

A assimetria informacional

Mesmo sem manipulação direta, há outro fator: telemetria.

Os Sistemas de IA recolhem dados de utilização — prompts, padrões, erros, volume, comportamento agregado. Mesmo quando anonimizados, geram conhecimento estratégico.

Se as empresas externas acumulam informação estrutural sobre como instituições europeias operam — desde os ministérios a empresas energéticas — criam uma vantagem informacional silenciosa.

Não é espionagem clássica.

É economia de dados aplicada ao poder.

Supply chain invisível

A IA não é apenas o modelo central. É um ecossistema de dependências:

- bibliotecas open-source,

- frameworks de treino,

- sistemas de autenticação,

- plataformas de armazenamento,

- fornecedores de chips.

Uma alteração numa camada intermédia pode afetar milhares de sistemas integrados.

Num conflito, a vulnerabilidade não precisa de ser ativada com um “ataque”. Basta uma interrupção na cadeia de fornecimento.

O cenário extremo: manipulação direcionada

A pergunta mais desconfortável é esta: poderia um modelo ser programado para enviesar decisões europeias?

Em teoria, sim.

Na prática, seria difícil implementar a manipulação grosseira sem detecção.

Mas a manipulação subtil — alterações graduais, pequenas distorções, restrições seletivas ativadas por contexto geográfico ou institucional — seriam muito mais difíceis de identificar.

E em situação de crise, quando ruído informacional é elevado, essas pequenas distorções podem ter impacto acumulativo.

Não é necessário mentir.

Basta definir prioridades diferentes.

O erro europeu: tratar IA como software, não como infraestrutura estratégica

A Europa discute ética de IA, regulação, proteção de dados.

Mas discute pouco a sua posição numa arquitetura global dominada por empresas e infraestruturas externas.

Se os setores críticos europeus adoptam modelos e serviços de empresas cuja política externa é definida por governos estrangeiros, então a autonomia estratégica torna-se retórica.

Não porque haja conspiração.

Mas porque há assimetria estrutural.

Dependência tecnológica em tempos de paz pode parecer eficiência económica.

Em tempos de conflito, transforma-se numa vulnerabilidade sistémica.

O contra-argumento necessário

Sem cooperação internacional, a Europa ficaria tecnologicamente isolada.

Desenvolver modelos próprios exige investimento massivo, tempo e coordenação política que a UE raramente consegue mobilizar.

E, realisticamente, nenhum sistema moderno é totalmente soberano.

Tudo isto é verdade.

Mas soberania absoluta não é a única alternativa à dependência total.

Existe uma terceira via: redundância estratégica.

O que reduziria o risco?

- Capacidade europeia de modelos próprios, mesmo que não liderem o mercado global.

- Infraestruturas soberanas para sectores críticos (defesa, energia, administração pública).

- Arquitetura multi-fornecedor, evitando dependência única.

- Auditorias técnicas contínuas com equipas independentes.

- Cláusulas contratuais de continuidade operacional em crise.

- Testes de resiliência geopolítica, tal como existem testes de stress bancário.

Isto não elimina risco.

Mas reduz a exposição.

A questão decisiva

Numa guerra, a pergunta não é se a IA “mentirá”.

A pergunta é: quem pode desligá-la, alterá-la ou limitá-la — e em que condições?

Se a resposta não for “nós”, então a dependência é real.

A Europa habituou-se a pensar a soberania como território e defesa convencional.

Mas no século XXI, a soberania inclui a capacidade computacional, controlo de modelos e autonomia infraestrutural.

Ignorar isto não é neutralidade tecnológica.

É vulnerabilidade estratégica voluntária.

O risco maior não está na ética declarada das empresas.

Está na arquitectura da dependência.

Se amanhã uma crise grave opuser interesses europeus a interesses do país onde se encontram os centros de decisão dessas empresas, a Europa descobrirá — talvez tarde demais — que não controla integralmente as ferramentas que estruturam a sua própria governação.

E num mundo onde a informação é arma e a infraestrutura digital é campo de batalha, depender de sistemas que podem ser ajustados externamente não é apenas questão técnica.

É questão de poder.

E poder, quando não é controlado por quem dele depende, raramente atua em favor de quem depende.

Subscrever a Newsletter