Linha editorial: ANÁLISE · Tecnologia · Estados Unidos · China · Inteligência Artificial

Na manhã de 27 de Janeiro de 2025, a capitalização bolsista da Nvidia caiu seiscentos mil milhões de dólares numa única sessão. Não houve acidente nem fraude — só uma empresa de Hangzhou que tinha publicado, na véspera, um modelo de inteligência artificial capaz de executar tarefas comparáveis às dos sistemas de ponta americanos, treinado com chips que os Estados Unidos tinham explicitamente proibido de exportar para a China. O modelo chamava-se DeepSeek R1. O custo declarado de treino rondava os seis milhões de dólares. O modelo americano de desempenho semelhante tinha custado centenas de vezes mais.

Washington travou chips. A China avançou.

Em Palo Alto, os engenheiros releram o relatório técnico duas, três vezes. Em Washington, houve reuniões de emergência. Em Pequim, ninguém ficou particularmente surpreendido.

A história oficial das restrições americanas às exportações de chips de IA tem a aparência de uma dedução: os Estados Unidos produzem os semicondutores mais avançados do mundo, a China precisa deles para desenvolver inteligência artificial competitiva, logo, negar o acesso abrandará o desenvolvimento chinês. O que se passou foi outra coisa — não o fracasso simples de uma política, mas algo mais difícil de enquadrar e, por isso, mais difícil de corrigir.

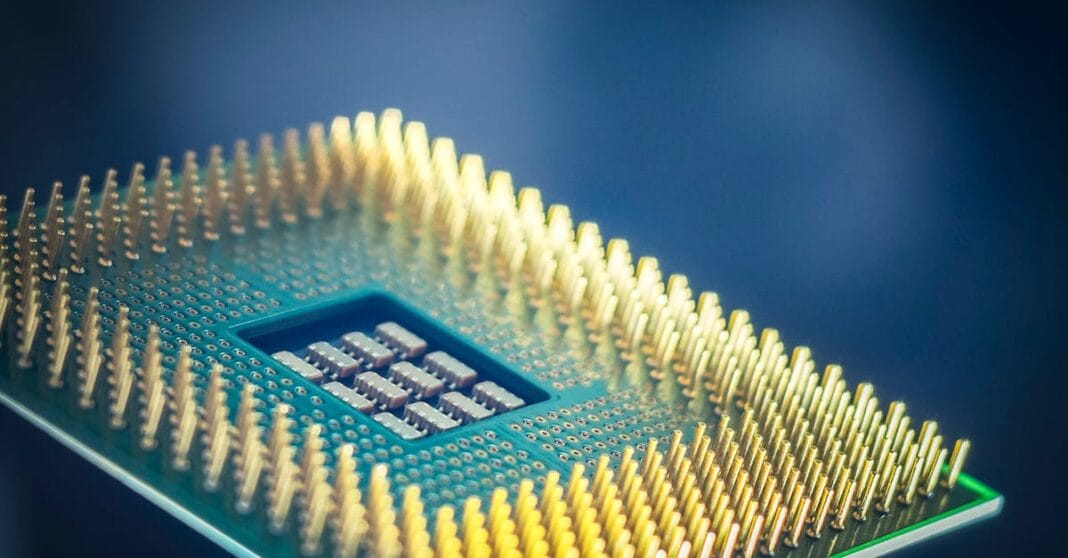

Quando o Departamento de Comércio americano classificou o chip H100 da Nvidia como produto de duplo uso sujeito a controlo de exportação, a Nvidia desenvolveu rapidamente uma versão alternativa — o H800 — com largura de banda de memória reduzida, especificamente para continuar a vender à China sem violar as restrições. Os engenheiros chineses receberam o chip degradado e puseram-se a trabalhar. Sem lamento público. Com um problema de engenharia para resolver.

A largura de banda de memória é um dos principais constrangimentos no treino de modelos de linguagem de grande escala. Com o H800, cada operação levava mais tempo, exigia mais iterações, acumulava mais fricção. Não é o tipo de obstáculo que paralisa — é o que obriga a repensar a ordem em que os problemas são abordados, a hierarquia do que pode ser sacrificado sem perda de desempenho real. Os engenheiros do DeepSeek redesenharam a arquitetura de treino em torno desta limitação, não à sua margem. Desenvolveram técnicas de otimização de memória que permitiam distribuir as operações de forma mais eficiente entre chips menos potentes — entre elas um mecanismo de atenção que comprimia o espaço de representação interna para caber dentro dos constrangimentos do H800 sem degradar a qualidade das respostas. No processo, redescobriram decisões de arquitetura que tinham sido ignoradas nos laboratórios americanos precisamente porque o poder bruto de computação tornava a elegância dispensável — e que, na ausência desse poder bruto, produziam resultados inesperadamente bons.

Existe uma técnica no campo da inteligência artificial chamada destilação do conhecimento. Em vez de treinar um modelo do zero, utiliza-se um modelo grande e caro — o “professor” — para gerar dados de treino que um modelo mais pequeno e barato — o “aluno” — aprende a imitar. O aluno não recebe o código-fonte do professor. Recebe os resultados: as respostas, os padrões, os comportamentos observáveis. A partir disso, reconstrói uma versão funcional da competência subjacente.

Desde 2022, os laboratórios americanos têm publicado os seus modelos de fronteira, ou variantes próximas deles, como sistemas de acesso público — uma escolha que combina convicção genuína sobre os benefícios da ciência aberta com cálculos de visibilidade e captação de utilizadores. Cada publicação é, involuntariamente, uma aula. Os engenheiros chineses sentaram-se na primeira fila.

Não é cópia. A destilação produz um modelo diferente, com arquitetura diferente, treinado com dados diferentes, que consegue fazer coisas semelhantes. Aproxima-se do que acontece quando um pianista estuda sistematicamente as gravações de outro até perceber a mecânica por trás do som — a distribuição do peso, a gestão do tempo, as escolhas de respiração — e depois toca por conta própria. O resultado não é plágio. É uma competência adquirida a partir de evidência pública, construída por dentro. O Qwen da Alibaba, o Ernie da Baidu, variantes mais recentes do próprio DeepSeek — todos cresceram num ecossistema em que os modelos de fronteira americanos que os precederam estavam disponíveis como referência pública. A cadeia de aprendizagem é pública e, em grande medida, intencional do lado que a disponibiliza.

Não há remédio óbvio para isto. As restrições a chips podem ser apertadas — e têm sido, com sucessivas actualizações às listas de controlo de exportação. O acesso a centros de dados em países terceiros pode, em teoria, ser complicado por sanções secundárias que pressionem governos no Sudeste Asiático a não hospedar capacidade de computação usada por empresas chinesas. Mas proibir a publicação científica destrói o próprio ecossistema que se pretende proteger. E a destilação não para enquanto os modelos de referência forem acessíveis. É uma corrida em que um dos competidores vai deixando para trás, a cada iteração, instruções de treino que o outro aproveita.

A história da tecnologia oferece paralelos que a retórica do “atraso forçado” raramente convoca. As câmaras fotográficas japonesas dos anos 1950 e 60, produzidas em fábricas que ainda recuperavam da guerra, entraram no mercado americano com uma relação qualidade-preço que os fabricantes estabelecidos não conseguiam igualar. A Leica e a Zeiss tinham os recursos, a reputação, a herança de engenharia. A Nikon e a Canon tinham a necessidade. A pressão não eliminou a competência japonesa — selecionou-a. Forçou escolhas que a abundância não forçaria, e algumas dessas escolhas revelaram-se vantagens duradouras. Os foguetes soviéticos contam uma história semelhante: sem o orçamento do programa americano, os engenheiros construíram sistemas mais robustos, mais simples de fabricar, mais tolerantes a variações nos componentes. A vantagem americana era visível quando tudo corria bem. Quando as coisas corriam mal, a diferença de filosofia tornava-se estrutural.

Nenhuma destas analogias encaixa na íntegra. Mas todas apontam para o mesmo ponto cego na lógica dos controlos de exportação: a suposição de que a escassez de inputs produz necessariamente escassez de outputs. Em certas condições, produz outputs com uma constituição diferente — concebidos para funcionar com menos, sob pressão, quando a cadeia de abastecimento se parte.

Sebastian Mallaby, economista e membro do Council on Foreign Relations, visitou a China na primavera de 2026 e regressou convicto de uma proposta: os Estados Unidos deveriam abandonar a estratégia dos controlos de exportação e negociar, em alternativa, um tratado global de não-proliferação da IA — um equivalente funcional do Tratado de Não-Proliferação Nuclear de 1968. A China, argumenta ele, está suficientemente preocupada com a segurança da IA para ser um parceiro negocial real.

O diretor executivo de uma empresa tecnológica chinesa admitiu, durante a visita, que faria sentido deixar de publicar modelos poderosos em código aberto à medida que a IA se torna mais capaz. A comparação que usou foi com armas nucleares. O governo de Pequim, por seu lado, desaconselhou o uso de um determinado assistente de IA em sistemas estatais, preocupado com vulnerabilidades de dados.

As preocupações existem. A questão é de que género são.

No DeepMind, no OpenAI, nos relatórios da Casa Branca sobre sistemas avançados, no UK AI Safety Institute, o problema central tem um nome próprio: alinhamento. O que acontece quando um sistema suficientemente avançado começa a perseguir objetivos que divergem dos objetivos humanos — não por sabotagem, não por má fé, mas porque os objetivos não estavam suficientemente bem especificados? Quando a capacidade do sistema excede a capacidade de o auditar e corrigir, quem deteta o desvio? São questões filosóficas com implicações técnicas muito concretas, e o campo que as estuda tem a sua própria linguagem, os seus próprios métodos, as suas próprias disputas sobre o que conta como risco real e o que conta como especulação.

O que os interlocutores de Mallaby expressaram pertence a outro registo. Quando o professor de gestão entrevistado afirma que um determinado assistente de IA torna o computador “nu” — vulnerável, exposto —, está a falar de segurança de dados, de exposição de informação, de quem tem acesso ao quê e em que condições. Quando Pequim desaconselha o uso desse sistema em contextos estatais, está a exercer a prudência soberana habitual em relação a tecnologia estrangeira ou não auditada internamente. Tratar estas preocupações como equivalentes à questão do alinhamento porque ambas usam a palavra “segurança” é um erro com consequências práticas para qualquer negociação — não um erro teórico mas um erro de desenho, do género que faz os tratados falharem nos detalhes depois de terem sido assinados com solenidade.

Um tratado de não-proliferação da IA exigiria, antes de mais, que as duas partes concordassem sobre o que o tratado regula. Com as armas nucleares, o objeto da regulação tem fronteiras físicas identificáveis: o material fissionável, os dispositivos de detonação, os testes atmosféricos, o arsenalamento. Há instalações que podem ser inspeccionadas, assinaturas isotópicas detectáveis em amostras de ar, dados sísmicos que registam detonações subterrâneas. O Tratado de 1968 funciona — na medida em que funciona — porque o que regula pode ser tocado, medido, rastreado.

Um modelo de linguagem é um ficheiro. Pode ser copiado, comprimido, deslocado para outro servidor, re-treinado com novos dados num prazo de semanas. Um modelo treinado em Singapura com dados públicos americanos por uma empresa sediada nas Ilhas Caimão não tem uma assinatura nacional verificável. A capacidade de construir sistemas poderosos dispersou-se por laboratórios universitários, startups, equipas de engenharia em dezenas de países com acesso a modelos de código aberto publicados pelos próprios laboratórios americanos. As propostas que têm circulado nos fóruns de governação da IA — limites à quantidade de computação usada no treino, obrigações de notificação prévia ao treinar acima de determinados limiares, auditorias de modelos por organismos internacionais — esbarram todas na mesma dificuldade: o objeto que pretendem regular não tem fronteira física, e quem o detém pode sempre alegar que o sistema em causa fica abaixo do limiar relevante. O que seria verificado, exactamente? Com que metodologia? Com que base legal para inspecções em território chinês?

O que determinará a posição relativa das duas potências não é o poder bruto dos modelos mas a sua incorporação em processos reais — industriais, militares, logísticos.

A Huawei instalou sistemas de IA para manutenção preditiva em comboios de alta velocidade — redes que transportam mais de dois mil milhões de passageiros por ano e onde uma avaria em trânsito tem custos que tornam o investimento em manutenção antecipada trivialmente justificável. A Hikvision integrou visão computacional em operações mineiras, reduzindo o número de trabalhadores necessários em zonas de risco elevado e aumentando a capacidade de monitorização de equipamento em tempo real. Outras empresas, cujos nomes raramente aparecem na imprensa ocidental, gerem com recurso a IA cadeias de abastecimento, redes de energia, sistemas de controlo de qualidade da água. Esta não é a IA dos comunicados de imprensa e dos benchmarks de raciocínio lógico. É a IA que já está dentro das coisas — integrada em infraestrutura, dependente de dados locais, difícil de substituir.

O paradoxo é que as restrições americanas contribuíram para este resultado de uma forma que os seus arquitetos não anteciparam. Uma empresa que não tem acesso garantido aos melhores chips do mundo não pode construir a sua estratégia sobre a suposição de que esses chips estarão sempre disponíveis. Tem de construir sistemas que funcionem com o que há — com chips menos potentes, com arquiteturas de software mais eficientes, com pipelines de treino que toleram instabilidade de abastecimento. Quando esses sistemas são depois implantados em contexto industrial, trazem consigo a robustez que foi necessária para os construir. Foram testados sob condições adversas antes de serem lançados. E quando as condições se tornam adversas novamente — por novas sanções, por disrupções geopolíticas, por restrições de acesso a componentes — continuam a funcionar.

Há uma conversa que não aparece no relato de Mallaby, e que provavelmente não poderia aparecer nos doze encontros que descreve com líderes tecnológicos em Pequim, Xangai, Shenzhen e Hangzhou. O sistema em que operam tem os seus próprios mecanismos de seleção para quem chega a essas conversas, e os seus próprios limites ao que pode ser dito com franqueza a um jornalista americano de passagem.

A conversa em falta é sobre o que a IA faz dentro da China. Os sistemas de reconhecimento facial integrados em câmaras de vigilância que cobrem espaços públicos, estações, universidades. A monitorização de plataformas digitais em tempo real, a classificação de comportamentos, a construção de perfis de utilizadores a uma escala e com uma granularidade que não têm precedente na história das tecnologias de controlo. Não porque esses sistemas sejam exclusivamente chineses — outros governos desenvolvem capacidades semelhantes, com maior ou menor grau de transparência, com enquadramentos legais mais ou menos robustos. Mas um tratado de segurança da IA que deixe esta dimensão fora do âmbito de regulação é um acordo sobre proliferação de capacidades entre grandes potências, não sobre os riscos que a IA já produz no interior de cada uma delas.

Nas semanas que se seguiram à publicação do DeepSeek R1, um investigador americano escreveu numa rede social que o momento lembrava o Sputnik. A comparação era compreensível — a surpresa, a escala da reação, o sentimento de que algo tinha mudado de forma irreversível. O Sputnik soviético foi construído com recursos que os Estados Unidos não tinham tentado negar à União Soviética. Era uma demonstração de capacidade autónoma, numa corrida em que os dois lados partilhavam acesso à mesma classe de materiais. O DeepSeek foi construído com chips degradados, com técnicas de destilação aplicadas a modelos publicados por laboratórios americanos, por equipas formadas precisamente pela pressão de produzir com menos.

Os Estados Unidos chegam a essa negociação numa posição que a retórica da liderança tecnológica tende a ocultar. A vantagem que os controlos de exportação pretendiam preservar — o acesso privilegiado à computação de fronteira — já não existe da forma que se imaginava quando a política foi concebida. Do outro lado da mesa estará um interlocutor que passou três anos a construir a sua capacidade tecnológica sob embargo parcial, que aprendeu a não depender do que o outro lado controla, e que tem sistemas implantados em infraestrutura crítica que não exigem aprovação americana para continuar a funcionar. Quem não precisa do que tens a oferecer negocia a partir de outro lugar.

O Tratado de Não-Proliferação de 1968 foi possível porque as potências nucleares tinham interesse direto em impedir que outros atores adquirissem a mesma capacidade. A assimetria era verificável — quem tinha a bomba e quem não tinha — e as potências nucleares queriam preservá-la. Numa eventual negociação sobre IA, essa assimetria está a esfumar-se. O que reste para negociar não será a proliferação de uma capacidade que uma das partes monopoliza. Serão normas de uso — o que se pode fazer, em que circunstâncias, com que obrigações de transparência, com que mecanismos de responsabilização quando algo corre mal.

Dois adversários com capacidades comparáveis podem ter interesse em criar normas partilhadas mesmo sem confiança plena — a história do controlo de armamento durante a Guerra Fria mostra que isso é possível, e ignorá-lo por fatalismo é uma forma de irresponsabilidade política. Mas antes do tratado existe uma pergunta mais básica: sobre o quê, exactamente, é que as duas partes estão dispostas a negociar? Não como princípio, mas como objeto verificável, como mecanismo de supervisão, como definição acordada do que conta como risco partilhado e do que fica fora do âmbito. Sem essa resposta, a negociação é uma aspiração — e uma aspiração é uma coisa diferente de um tratado.

Os chips continuam a empilhar-se. Os modelos continuam a aprender com os modelos anteriores, incluindo com os que foram construídos para os substituir. Algures num centro de dados no Sudeste Asiático, um servidor que formalmente não tem origem nacional está a processar, neste momento, algo que ninguém autorizou e que ninguém vai saber.